Durante años, el anonimato en internet ha funcionado más como una ventaja práctica que como una protección real. Para mucha gente, abrir una cuenta secundaria, comentar bajo un seudónimo o usar un throwaway en Reddit era suficiente para hablar con libertad sin mezclar vida personal y pública. Un nuevo estudio académico sugiere que esa “oscuridad práctica” —la idea de que nadie va a molestarse en investigarte— se está debilitando por un motivo muy concreto: la Inteligencia Artificial ha abaratado y automatizado la desanonimización.

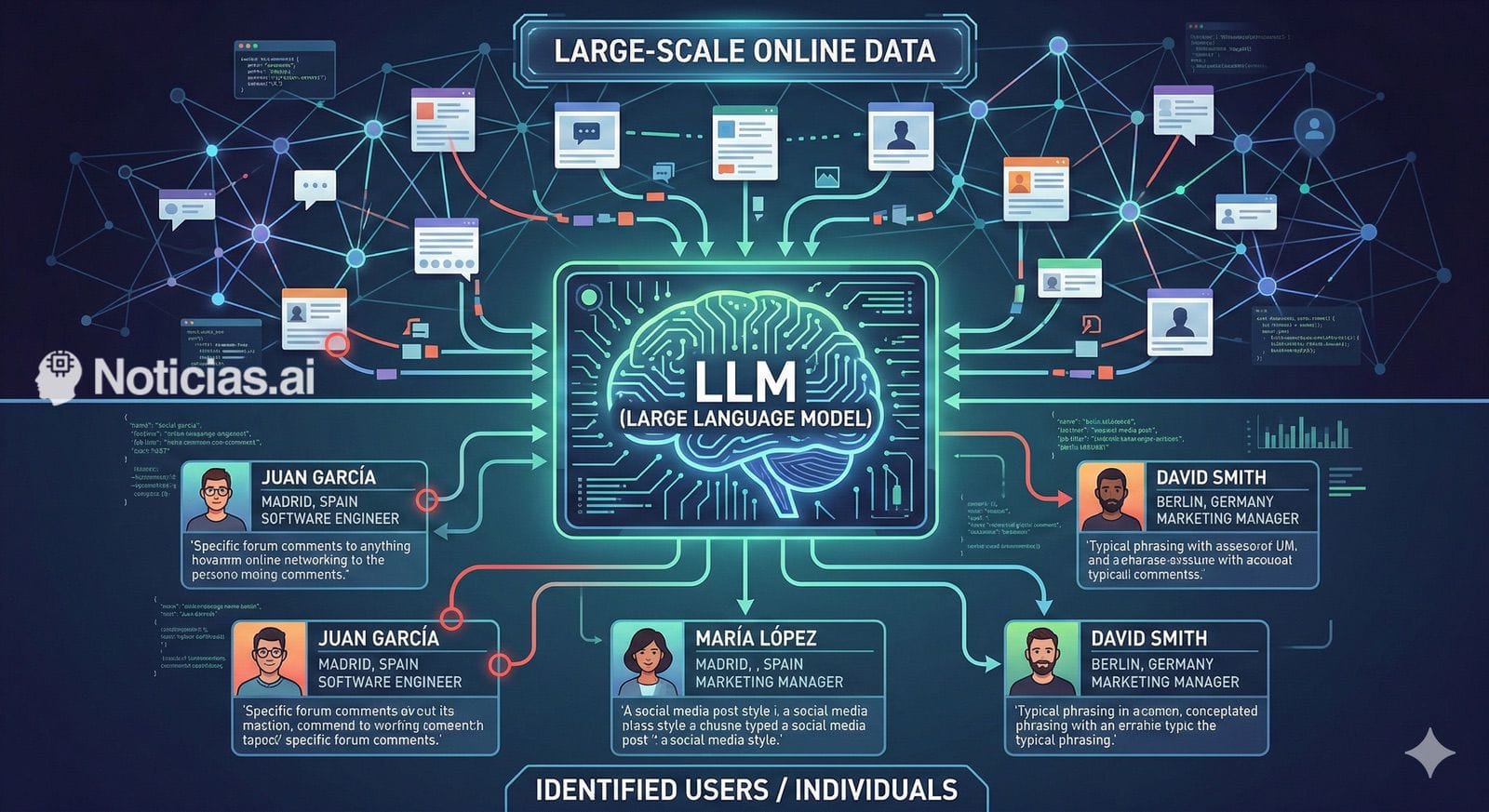

El trabajo se titula Large-scale online deanonymization with LLMs y está firmado por investigadores vinculados a ETH Zurich, Anthropic y MATS. Su tesis es contundente: los modelos de lenguaje de gran tamaño (LLM, por sus siglas en inglés) cambian la economía del rastreo de identidades, haciendo viable lo que antes requería muchas horas de investigación manual y un objetivo “de alto valor”.

Qué significa “desanonimizar” y por qué esto cambia el juego

La desanonimización no es “hackear” una cuenta. Es algo más mundano y, precisamente por eso, más difícil de frenar: leer lo que alguien ha publicado a lo largo del tiempo, extraer señales (intereses, profesión, lugares, forma de expresarse, rutinas, detalles biográficos) y buscar coincidencias en internet hasta poder decir: “esta persona es probablemente X” o “esta cuenta secundaria pertenece a la misma persona que esta otra”.

Históricamente, este tipo de ataques existían, pero eran caros: necesitaban datos estructurados o un analista paciente revisando publicaciones durante horas. El estudio sostiene que, con LLMs, ese trabajo se convierte en un proceso escalable: la IA resume, encuentra patrones, propone candidatos y decide si “se atreve” a dar un resultado o si es mejor abstenerse.

Los datos que más preocupan: precisión alta y coste bajo

Para evitar daños, los autores no se dedican a perseguir cuentas realmente anónimas al azar. Construyen conjuntos de prueba con “verdad de referencia”, es decir, casos donde la identidad estaba verificada por enlaces públicos y luego se elimina la información directa para comprobar si el sistema puede reconstruir el vínculo.

En el experimento más ilustrativo, recopilan 338 usuarios de Hacker News que habían enlazado su perfil de LinkedIn en la biografía (lo que permite verificar identidad). Tras anonimizar pistas obvias y ejecutar su agente con acceso a búsquedas web, el sistema identifica correctamente a 226 objetivos: 67 % de recall con 90 % de precisión, además de un número relevante de abstenciones cuando no está suficientemente seguro.

El coste también es parte central del mensaje: ejecutar el agente por perfil les costó entre 1 y 4 dólares, y el conjunto de experimentos se mantuvo por debajo de 2.000 dólares. Traducido a la vida real: ya no hace falta ser una agencia ni un equipo experto para probar suerte con cientos de objetivos. La barrera de entrada, según el paper, baja de forma drástica.

Funciona más allá de un sitio: perfiles, foros y hasta transcripciones “anonimizadas”

El estudio no se limita a un único contexto. Evalúa distintos escenarios que reflejan amenazas cotidianas en redes sociales:

- Vincular un seudónimo con una identidad real (por ejemplo, unir una cuenta en un foro a un perfil profesional).

- Encontrar la cuenta seudónima de alguien conocido (cuando el atacante parte de una identidad real y busca “dónde comenta esa persona”).

- Relacionar entre sí cuentas del mismo usuario (por ejemplo, unir cuentas secundarias o cuentas creadas en épocas distintas).

Uno de los puntos más delicados aparece al analizar transcripciones de entrevistas publicadas y parcialmente redactadas para proteger a los participantes. En el Anthropic Interviewer dataset (entrevistas sobre uso de herramientas de Inteligencia Artificial en investigación), los autores ejecutan su enfoque sobre 33 científicos y reportan identificaciones correctas en 9 casos, con 82 % de precisión y numerosas abstenciones. Ellos mismos reconocen limitaciones para verificar el “éxito real” en este escenario, pero el ejemplo sirve para poner sobre la mesa una preocupación: borrar nombres no siempre elimina el contexto suficiente para impedir la reidentificación.

Por qué las “cuentas secundarias” son especialmente vulnerables

El paper insiste en una idea que, en redes sociales, se entiende rápido: el problema no es un comentario aislado, sino la acumulación. Con el tiempo, un seudónimo persistente reúne cientos de piezas pequeñas: un barrio mencionado, un tipo de trabajo, un evento local, un lenguaje técnico habitual, una afición de nicho, horarios de publicación, incluso expresiones recurrentes. Por separado, nada identifica. Juntas, esas piezas forman un patrón.

La IA no necesita “adivinar” con magia. Le basta con hacer lo que haría un investigador humano, pero más rápido y con una capacidad enorme para comparar y filtrar candidatos. Esa automatización es la que rompe la sensación de seguridad basada en la pereza del atacante.

“Guardrails” y límites: los autores no ven una solución fácil

En su discusión, los investigadores señalan que medidas como límites de tasa, detección de scraping o restricciones a exportaciones masivas de datos pueden reducir el impacto, pero no resuelven el núcleo del problema cuando la información ya es pública y indexable. También apuntan a que los proveedores de modelos podrían monitorizar usos abusivos y reforzar barreras de seguridad, aunque advierten de un matiz incómodo: muchas partes del proceso se parecen a tareas legítimas (resumir perfiles, calcular similitudes, ordenar resultados), lo que dificulta bloquearlo sin romper usos normales.

El estudio además subraya que marcos clásicos de anonimización pensados para bases de datos estructuradas no encajan bien con el mundo de texto libre y señales semánticas. Y lanza una advertencia final: las plataformas deberían asumir que, a escala, usuarios seudónimos pueden ser vinculados entre sí y con identidades reales, influyendo en cómo se gestionan datos públicos y políticas de acceso.

Qué puede hacer el usuario medio sin caer en falsas promesas

No existe una “receta” que garantice anonimato absoluto, pero sí decisiones que reducen el riesgo:

- Evitar que un seudónimo acumule demasiadas pistas consistentes durante años.

- Pensar dos veces antes de compartir microdetalles repetibles (ubicación precisa, empresa, proyectos, rutinas).

- Separar de verdad identidades: no solo con otra cuenta, también con hábitos y temas menos correlacionables.

- Revisar publicaciones antiguas que sigan indexadas y aporten contexto innecesario.

La conclusión del estudio no es que todo el mundo vaya a ser identificado mañana, sino que el coste de intentarlo ha caído lo suficiente como para que cambien los incentivos. En la práctica, eso obliga a repensar qué significa “publicar bajo seudónimo” en 2026.

Preguntas frecuentes (FAQ)

¿Esto significa que cualquiera puede descubrir mi identidad real en redes sociales?

No siempre, pero el estudio muestra que en algunos escenarios la IA puede identificar con alta precisión cuando hay suficiente historial público.

¿Qué es un LLM y por qué ayuda a desanonimizar?

Es un modelo de Inteligencia Artificial entrenado con texto que puede resumir, inferir señales y comparar perfiles a gran escala.

¿Un throwaway en Reddit sigue siendo “seguro”?

Depende: cuanto más contenido y más microdetalles acumule, más fácil es que se pueda relacionar con otras cuentas o identidades.

¿Borrar mi nombre de un texto o una entrevista garantiza anonimato?

No: el contexto y las pistas indirectas pueden permitir reidentificación, según los experimentos con transcripciones parcialmente redactadas.

Fuente: ArXiV